Diffuusiomallit – kuvia videoita ja ääntä kohinasta

Kirjoittanut: Markus Sjöberg

0:00 / 0:00

Diffuusiomallit ovat mahdollistaneet monet luovalle alalle keskeiset generatiivisen tekoälyn työkalut. Niiden avulla voi luoda kuvia, ääntä ja videota. Yksinkertaistettuna diffuusiomalli luo sisältöä aloittamalla satunnaisesta kohinasta ja vähitellen muokkaamalla sitä tunnistettavaksi ja yksityiskohtaiseksi lopputulokseksi. Prosessi muistuttaa hieman valokuvan kohinan poistamista: aluksi kuva on epämääräinen ja rakeinen, mutta prosessin edetessä kuva selkiytyy ja yksityiskohdat tulevat esiin. Samalla tavoin tekoäly rakentaa kokonaan uuden kuvan tekstiohjauksen avulla, vähentämällä keinotekoisesti luotua kohinaa askel askeleelta ja tuottamalla näin selkeän ja visuaalisesti kiinnostavan lopputuloksen (Ho ym. 2020).

Etenkin kuvien luontiin hyödynnetyt mallit ovatkin syntyneet ikään kuin kehittyneenä kohinanpoistona. Niiden koulutusprosessissa kuviin on lisätty kohinaa askel askeleelta, kunnes kuvat ovat olleet vain epämääräistä kohinaa. Kun prosessi on käännetty toisin päin, voi malli palauttaa kuvan sellaisesta tilanteesta, jossa sitä ei oikeasti ole. Se siis näkee tuttuja muotoja ja kykenee niiden avulla luomaan sellaisia kuvia, joita ei koskaan ollutkaan. Kohinanpoiston lisäksi malleille on koulutettu laaja merkitysverkosto kuvien ja tekstikuvausten välisistä yhteyksistä. Diffuusiomallin sisällä kaikki, niin sanat kuin kuvan yksityiskohdat, koodataan vektoreiksi. Vektori on käytännössä pitkä lista lukuja, jotka kuvaavat asian paikkaa valtavassa “merkitysavaruudessa”. Siinä avaruudessa esimerkiksi “kissa” ja “tiikeri” ovat lähekkäin, koska niillä on paljon yhteisiä piirteitä, mutta “kissa” ja “pilvi” sijaitsevat kauempana toisistaan. Näiden vektorien muodostama merkitysverkko toimii karttana, jonka avulla malli tietää, mitä yksityiskohtia kuhunkin kuvaan kannattaa lisätä. Kun malli kohinanpoiston aikana saa tietoa esimerkiksi vihreydestä ja pystysuoruudesta, se ikään kuin päättelee: “Tässä kuuluu olla kuusen runko.”

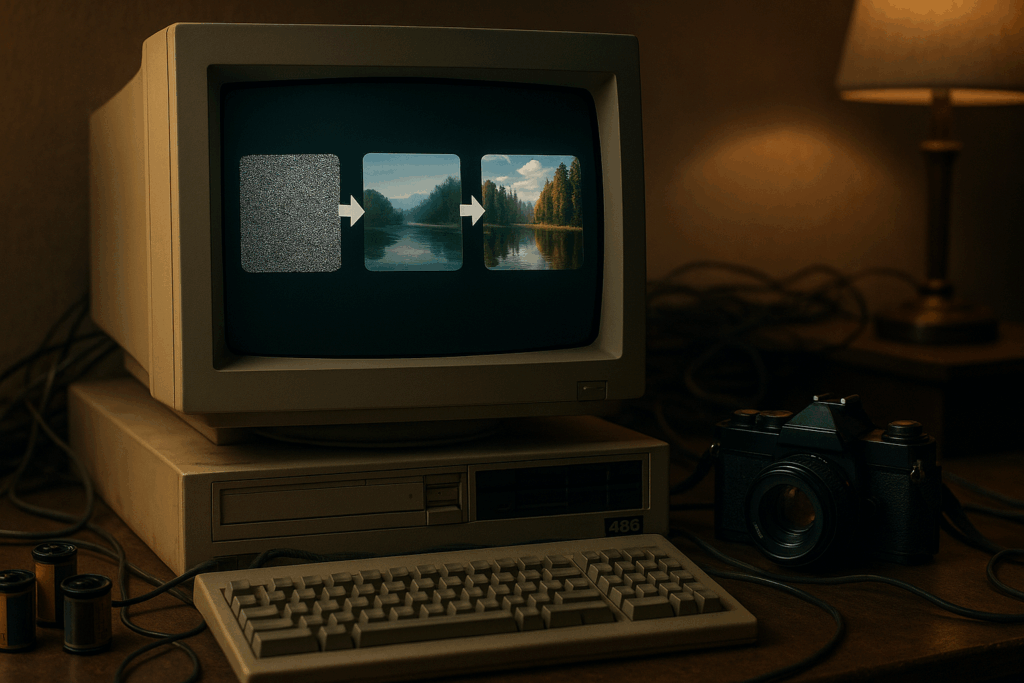

Diffuusiomallit luovat kuvia vaiheittain. Prosessi alkaa satunnaisesta kohinasta, kuvasta, joka näyttää epäselvältä pilveltä. Malli tulkitsee käyttäjän antaman tekstikuvauksen ja alkaa poistamaan kohinaa kuvasta vaihe vaiheelta, lisäten yksityiskohtia, jotka vastaavat tekstikuvauksen sisältöä. Lopputuloksena on kuva, joka siis pyrkii tulkitsemaan annetun tekstin merkityksen. Alla on esimerkki, miten Stable Diffusion luo kuvan tekstikuvauksella “landscape”. Stable Diffusion käyttää kuvan luomisprosessissa mekanismia, joka ohjaa mallia tekstin perusteella jo ensimmäisestä vaiheesta lähtien. Tämä ohjaus vaikuttaa siihen, miten ensimmäiset rakenteet alkavat muodostua ja siitä syystä jo ensimmäisessä kuvassa voi hahmottua muotoja, kuten ihmisiä tai maisemia.

Diffuusiomallien käyttö ei rajoitu vain kuviin. Videon luomisessa mallia käytetään periaatteessa samalla tavalla, jossa jokainen videon ruutu tuotetaan vaiheittain kohinaa poistamalla ja yksityiskohtia lisäämällä, mutta prosessissa huomioidaan tilan ja ajan jatkumo, jotta malli mahdollistaa hyvin realististen ja sulavien liikkeiden ja siirtymien luomisen, jotka muistuttavat aitoa (Ho ym. 2022). Äänidiffuusiomallit toimivat vastaavasti, jolloin ne tuottavat luonnollisen kuuloista puhetta tai muita ääniä aloittamalla sattumanvaraisesta kohinasta, jota muokataan askel askeleelta selkeäksi ääniaineistoksi (Kong ym. 2020).

Teknisenä erona kuviin verrattuna monissa videodiffuusiomalleissa ei generoida jokaista ruutua itsenäisesti, vaan malli käyttää niin sanottua aikajatkumon yhteistä diffuusiota: esimerkiksi Sora ja Lumiere hyödyntävät tilan ja ajan yhdistävää UNet-arkkitehtuuria, jossa kerralla luodaan useita peräkkäisiä frameja ja niiden väliset liikkeet. Tämä mahdollistaa liikkeen jatkuvuuden ja vähentää välkkymistä. Diffuusio etenee tässäkin kohinasta kohti tarkkaa tulosta, mutta aikajänne on osa mallin tilaa, eikä yksittäisiä kuvia tuoteta erikseen.

Jos haluat ymmärtää tarkemmin visuaalisten esimerkkien kautta sen, miten diffuusio toimii, voit tututustua vaikkapa Eryk Salvaggion informatiiviseen videoon Flowers Blooming Backward Into Noise (2023):